可以,但要看软件怎么处理方言:若把四川话当作口音来识别并把语音先转为标准汉语,再做机器翻译,效果会比较好;若仅支持书面普通话或没有方言训练数据,语音识别和翻译准确率就会下降。下面我会一步步讲清楚为什么、怎么测试、怎么优化,以及遇到问题有哪些可行替代方案。

先把问题拆开:什么叫“能翻译四川话”

这句话其实包含两个环节:一是“听懂/识别”四川话——也就是把口语变成文字(语音识别,ASR);二是“把识别出的文字翻译成另一种语言或标准表达”(机器翻译,MT)。如果任一环节出现问题,最终翻译就会不准。所以说“能不��能翻译”,要看两个环节是否都能处理方言特性。

用一个比喻理解(费曼式解释)

想象翻译过程像从四川方言口语到英语的快递:第一站是打包(把口音听成汉字),第二站是贴上英文标签(把汉字翻成英语)。如果打包的人听不懂方言,包裹里就不是原来要表达的东西;即便贴标签的人再厉害,也贴不了正确的英文。所以要两站都靠谱。

技术上为什么方言翻译比普通话难

- 语音差异大:四川方言在声母、韵母和声调上与普通话有明显不同,连常用词的发音也会变。

- 词汇和语法带地方特色:有一堆本地词(比如“幺儿”“得瑟”等)或固定搭配,标准模型可能没见过。

- 标准书面形式缺失:方言常是口头语,缺乏统一书写规范,训练数据稀缺。

- 数据匮乏:机器学习要靠大量方言语音-文字对,很多厂商没有专门采集充足的四川话语料。

简短技术流程(顺序说明)

- 语音采集 → 语音识别(把方言说成文字)

- 文字归一化(方言词映射到标准汉语词)

- 机器翻译(把标准汉语或方言文字翻成目标语言)

- 后处理(校正、语境调整)

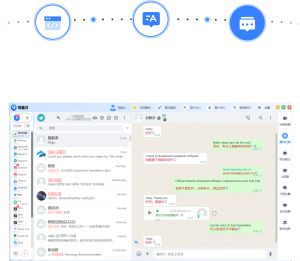

“易翻译”这类工具在不同功能下的表现差异

现在的大多数翻译工具都集成了几种功能:文本翻译、语音实时互译、拍照取词和双语对话。每种功能对方言的容忍度和实现方式不同,我把它们一一拆开来说:

文本输入翻译

- 优点:如果你先把四川话用文字写下来(用方言拼音或直接用普通话意译),机器翻译通常能处理得很好。因为这一步跳过了语音识别误差。

- 缺点:写下来本身就是门槛,很多方言词找不到合适的汉字或用词需要人工改写。

语音实时互译(最复杂)

- 需要专门的方言ASR模型才能高精度识别四川话发音。

- 很多工具的语音识别是基于普通话训练的,对川音和连读、省略敏感,很容易把词识别错或漏词。

- 有些产品会做“口音鲁棒性优化”,对常见方言做少量适配,这种情况效果一般能接受,但不会完美。

拍照取词与双语对话

- 拍照取词主要处理文字,和方言无直接关系,除非方言存在书面变体。

- 双语对话模式如果先把语音转文字再翻译,和语音实时互译遇到相同问题。

如何一步步验证“易翻译”是否能较好处理四川话

下面是一个可操作的测试清单,我通常会这样试(像做实验一样,简单可复现):

- 查清楚产品说明:在“支持语言/方言”列表里看是否明确提到“四川话”或“川话/川普”。

- 做短句测试:用几个很典型、词汇明确的四川方言短句录音,再看识别出的文字是否接近原意。

- 做长句/对话测试:真实对话往往有省略和俚语,试几段实际交流语音,观察错误类型。

- 对比模式测试:分别用语音输入和文字输入(把方言改写成普通话)比较翻译结果。

- 边说边观察识别文本:如果软件能显示实时转写,能帮助你看是ASR出错还是MT出错。

推荐的试验句(直接拿去测)

下面是几句代表性的四川话(括号里给普通话和英文参考)。你可以直接用这些句子来测试语音识别和翻译的表现:

| 四川话 | 普通话近义 | 英文译例 |

| 你吃饭安逸不? | 你吃饭舒服吗? | Are you comfortable after eating? |

| 莫得得嗦,走得起。 | 不要多说了,走吧。 | Don’t talk too much, let’s go. |

| 安逸得很,得瑟个啥。 | 非常舒服,别得意忘形。 | Very comfortable, don’t get too cocky. |

| 我去摆龙门阵。 | 我要去聊天(说笑)。 | I’m going to chat/hang out. |

如果你发现“易翻译”对四川话支持不好,该怎么办

别急着放弃,先试下面这些方法,往往能把结果显著改善:

- 改用文字输入:把方言意思改写为标准普通话再翻译,准确率最高。

- 分句说、放慢语速:短句更容易识别,避免连读和省略。

- 说得清楚些、减少口音缩减:尽量发准关键字(尤其人名地名、数字、专有名词)。

- 尝试方言友好的工具或本地化产品:一些厂商或研究项目有方言识别模块,可能更好。

- 给出上下文和重复确认:在双向对话中,使用确认环节(“你是说……对吗?”)减少误解。

商业或技术解决方案(如果你是产品/企业用户)

- 采集四川话语料,标注转写,用于训练或微调ASR模型。

- 在MT里加入方言归一化层,把常见的方言词映射到标准汉语。

- 启用在线反馈机制,让用户纠错并将纠错数据用于持续迭代。

一些常见误区(别被忽悠了)

- “会翻译100+种语言就一定会翻方言”:语言≠方言。方言多是同一语言的口语变体,技术上是另一类挑战。

- “机器翻译只靠词典就能解决”:方言的语音变化和省略需要声学模型识别,而不只是字面替换。

- “口语翻译永远不如人工”:短句、高频表达在训练得当时机器可以做得很快且实用,但语境复杂时人工仍更可靠。

举个更贴近生活的例子(我曾经这样做的步骤)

我会先把对话录下,听一遍把能听懂的写下来(即使是方言词),再把这些方言词换成普通话表达,最后把标准化后的文字输入翻译软件。这样做有点麻烦,但你会发现很多“听不懂”是ASR的问题,一旦把口语变成清晰的文字,机器翻译就很给力了。

实用小技巧

- 在嘈杂环境不要用实时语音翻译;找个安静角落,或者用外接麦克风。

- 有专有名词时,先在文本框里写好再读出来,帮助识别引擎学习。

- 遇到“识别结果和意思差很多”的情况,把识别出来的文字截图保存,反馈给客服或做二次校对。

说到这里,你大概能感觉到——能不能翻译好四川话,不是一个简单的“能”或“不能”。如果厂商对方言做了专门优化,尤其是训练了方言ASR和做了归一化映射,效果会明显好很多;如果没有,就需要靠改写、分句、人工润色或换工具来弥补。你可以按上面的测试步骤先验算一遍,再决定是调整使用习惯,还是寻找更专门的方案。顺便提一句,方言研究和工程在变好,未来几年会越来越靠谱,这事我还挺期待的。