易翻译看起来只是个翻译工具,但它实际上把语音识别、机器翻译、光学字符识别和语音合成四大技术揉在一起;很多不显眼的优化——离线模型、短语记忆、方言适配、照片取词的预处理、缓存与隐私策略——才真正决定了翻译的准确性、速度和好用程度,也影响你何时信任它、何时要人工校对。

先把“冷知识”分门别类,说清楚为啥值得在意

我想先把话说清楚:所谓“冷知识”,并不是噱头,而是那些影响你日常使用体验但不常被宣传的小细节。下面我会按技术层面、功能实现、隐私与交互这几条线讲,尽量把复杂的原理用简单比喻解释清楚——像费曼那样,先让你能用自己的话复述一遍。

核心技术其实像一台协作的流水线

语音识别(ASR)负责把声音变成文字;机器翻译(NMT)把文字从一种语言变成另一种;光学字符识别(OCR)把图片里的文字“读”出来;语音合成(TTS)把翻译后的文字读出来。想象一条车间流水线,任何一段出错,最终结果都会变差。

- ASR的冷知识:不同麦克风和不同噪声下,识别错误不会是随机的——它们有“偏好”,比如常把轻声尾音错成相近音,这种偏好可以通过微调模型和噪声模型降低。

- NMT的冷知识:现在主流用的是转换器(Transformer),它擅长“看全局”,但对专有名词、长表格或很口语化的句子不一定友好,所以短句往往更稳。

- OCR的冷知识:拍照前的一点小动作能决定识别率:光线、倾斜、背景杂物、字体间距都影响结果。许多APP会做“二次预处理”(去噪、校正、增强对比)而不是直接用原图。

- TTS的冷知识:选择不同的合成器会影响语速、重音和连读。你可能注意不到微妙的断句,但这正影响你能否听懂一句话的重点。

四大核心功能的那些不那么明显的细节

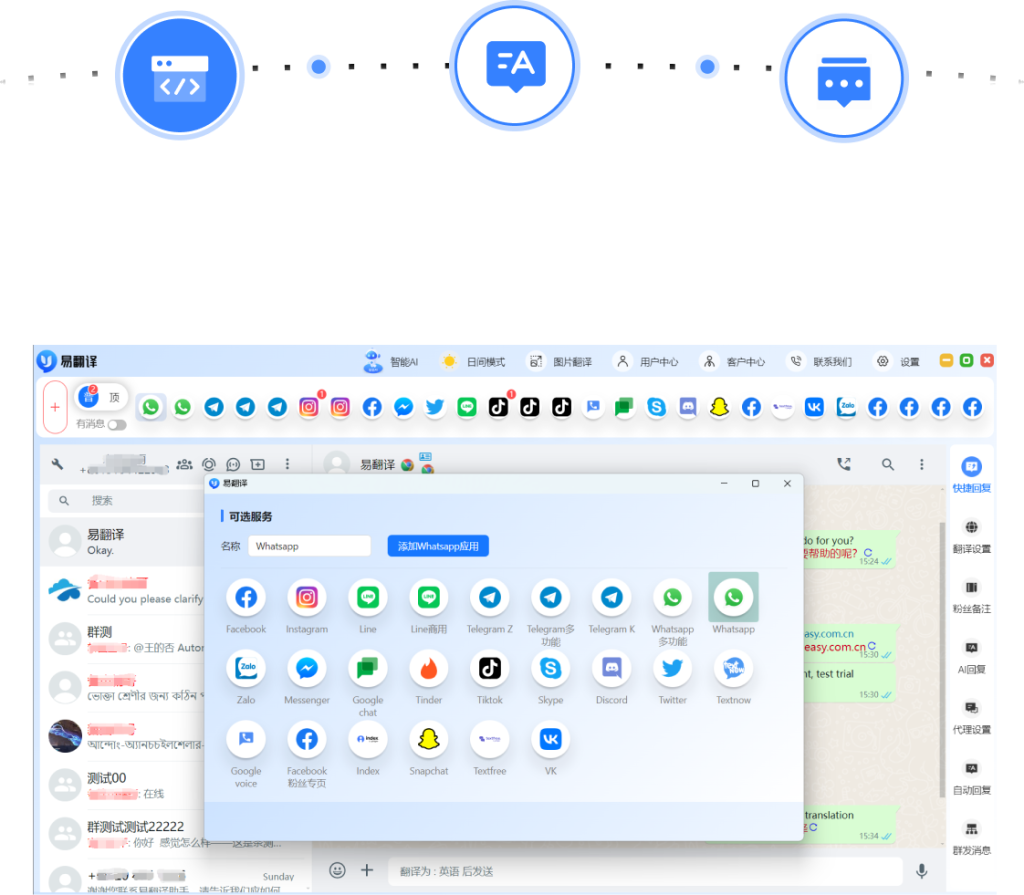

既然易翻译主打文本、语音、拍照取词、双语对话四项功能,我们就按功能来拆开讲,告诉你每项功能里常被忽视的“内幕”。

文本输入翻译:上下文、记忆和术语表比你想的更重要

输入一句话得到的翻译并不完全只是当前句子本身的作用。很多翻译工具会用上下文窗口来提升连贯性,而且会支持“术语表”或“词库记忆”功能,这些让专有名词或行业术语在不同句子里保持一致。你可能不知道的是,某些工具还会把用户常纠正的翻译保存在本地缓存里,下一次类似场景就能优先使用。

语音实时互译:延迟、断句与回退机制

实时语音翻译有两个核心痛点:延迟(latency)和准确性。为了减少延迟,系统会先发出“部分翻译”再补充完整(类似逐字字幕),但这样可能出现语义跳跃。更有意思的是,很多系统在检测到长时间沉默或标点后,会自动截断上一句并送入翻译,这就是为什么你在谈话里突然听到“句子中断”的原因。

拍照取词翻译:不是简单的“识别再翻译”

拍照取词看上去很直观,但实际流程包含多步:图像增强→版面检测→文本分割→字符识别→语言检测→拼写修正→翻译。任何一步的微小优化都会显著提升最终效果。比如,先做版面检测可以把拍到的杂乱背景和文本区域分开;再比如,对竖排文本、混合中英数字或手写体的特殊处理各不相同。

双语对话翻译:角色识别和回声抑制很关键

双语对话模式下,系统不仅要翻译,还要分辨谁在说话(说话人分离)并避免自己播放的语音被再次识别(回声抑制)。还有个细节:在同声传译和轮流对译之间要取舍,做得好的系统允许用户切换“更流畅但有延迟”的模式或“更即时但可能断句”的模式。

| 功能 | 常见优势 | 不明显的局限/优化点 |

| 文本翻译 | 准确、支持长文本、术语表 | 上下文窗口有限,长文需要分段;术语需手动维护 |

| 语音实时互译 | 便捷,接近自然对话 | 延迟与断句权衡、背景噪声敏感 |

| 拍照取词 | 快速识别实体文档或路牌 | 光照、倾斜、手写体和复杂排版影响大 |

| 双语对话 | 适合面对面交流 | 说话人分离、回声问题与本地化收敛 |

性能与体验:开发者常用的权衡与“小把戏”

这里说的“小把戏”不是黑箱诡计,而是工程上常用的折中手段,知道它们能帮助你理解为什么有时候翻译又准又慢,有时候又快又粗。

- 离线模型与在线模型的选择:离线模型方便隐私和无网环境,但模型体积受限,通常需要量化和剪枝,导致小幅降精度。在线模型能调用更大的网络,但会有网络延迟与隐私顾虑。

- 模型压缩技术:量化(把浮点数用更少位数表示)、蒸馏(把大模型的知识转移到小模型)和剪枝都是在设备上加速的常用手段,它们的副作用是对罕见词或复杂句型的泛化能力下降。

- 缓存与短语记忆:为减少重复翻译和提高一致性,很多应用会缓存你最近翻译的句子和用户定义的短语。这能大幅提升体验,但也可能导致“老版本翻译”在新上下文里被误用。

- 多引擎策略:在不影响体验的前提下,一些工具会并行调用多个译器(比如统计式+神经网络),再用投票或排名机制选择结果,以求稳定性。

隐私、安全与数据利用:别只看界面上的“我同意”

用户最关心的往往不是技术,而是“我的语音和照片会被保存吗?”这类问题。冷知识在于:同样一句“上传到云端”,不同厂商的处理方式和保留策略差别很大。

- 很多应用会区分“分析数据”和“日志数据”。分析数据用于改进模型(通常是匿名化的),日志数据则可能用于排查故障,保留期也不同。

- 有的工具在本地做预处理(如去噪、分割),把处理后的文本再发到服务器,文本比原音频更易于储存与检索,这一点对隐私影响比你想的要大。

- 若关注隐私,优先选择明确支持“仅本地处理”或“端到端加密”的产品,或者使用离线翻译包。

实用技巧:用得更顺手的小动作

这些小技巧多数人忽略,但能马上提升翻译准确性或体验:

- 拍照取词前,先把手机对准文本,轻触对焦并等相机稳定再拍;如果是竖排文本,尝试旋转手机或使用“识别列”功能。

- 语音翻译遇到噪声,尝试把手机靠近说话人且用麦克风挡住回声源;使用耳机麦克风通常效果更好。

- 长期使用同一领域时,建立术语表并导入(若APP支持),这样专有名词会一致且更专业。

- 如果担心隐私,优先使用“离线翻译包”,并定期清理历史缓存。

- 在双语对话模式里,给每个人分配“固定语音输出语言”(如果可能),能减少误判和回声。

常见误区和你应该如何判断翻译质量

有时候工具的输出看着“合理”,却并非可直接使用。判断质量的几个简单方法:

- 看是否保留了关键实体信息(人名、地名、时间、数值)。如果关键实体被误译或漏译,整句可信度低。

- 注意上下文一致性:同一文档或对话里,专有名词是否前后统一。

- 把译文反向翻译回原语言(用于快速自查),若意义大变,说明译文可能失真。

- 短句通常比长句更可靠;遇到复杂句子,尝试分句再翻译。

小插曲:为什么偶尔会出现“奇怪的词”

这是因为模型有时会“过度自信”地填补缺失信息,特别是在口语省略或OCR识别不完整的情况下。工程上称之为“hallucination(幻觉)”。识别到这种现象后,最稳妥的做法是人工核对关键信息。

最后,聊聊怎么把这些冷知识变成你的优势

知道原理后,你会发现很多问题其实有套路可循:拍照前的构图、语音时的麦克风姿势、术语表的建立、离线包的优先策略、以及对翻译结果的快速自检。掌握这些,不仅能让你少掉坑,还能在关键场景(如商务谈判、旅行紧急情况)里用得更稳当。

我写到这里,想着如果把每一项技术再拉出一个小故事讲会更有意思,但那会把文章拉得更长。你要是想,我可以把某一部分拆开来讲更具体的操作步骤或配图说明——好像在和朋友边走边聊,想到哪儿说到哪儿。就先这样吧,等你说想深入哪一块,我再把那一块做成“可复制的操作手册”。