易翻译的报告由四部分自动生成:输入捕获与预处理、识别与翻译引擎、后处理与质量评估、以及可视化报表与存储。系统先辨别语言并清洗文本,接着调用模型翻译,同时记录置信度与错误类型,最终汇总成便于阅读的报告,包含原文、译文、对齐、评分与改进建议。并附示例、高频问题与人工核对记录,便于追踪与改进。并支持导出啦。

先说个比喻,帮你快速理解

想象一次翻译像做一道家常菜:你先把材料洗净(预处理),然后把材料切好并按顺序下锅(模型识别与翻译),最后尝一尝是否需要加盐或改口味(后处理和人工校对)。易翻译的“报告”就是把这整锅菜的制作过程、味道评分、以及漏放了什么配料都写成一张清单,方便你回头查看、改进或复现。

报告到底包括哪些“部件”

把生成流程拆成更具体的四大模块来讲,便于理解每一步做了什么:

- 输入捕获与预处理:文本、语音或图片(拍照译词)都要先被识别并转换成标准化文本。

- 识别与翻译引擎:包括ASR(语音识别)、OCR(图像文字识别)和NMT(神经机器翻译)等核心算法的调用。

- 后处理与质量评估:译文润色、词汇对齐、置信度计算、自动质量评分与人工复核记录等。

- 可视化报表与存储:把原文、译文、对齐信息、评分、建议等整合成用户可读的报告,并支持导出和历史追踪。

输入捕获与预处理:为什么先“洗”材料

原始输入常常并不干净:口音、噪声、手抖拍糊了图片、或者用户粘贴了含有格式符号的网页文本。预处理的主要工作包括:

- 语言检测(快速判断输入是什么语言)

- 噪声过滤与字符正则化(例如把非标准引号、乱码、HTML标签去掉)

- 分句与分词(把长段落拆成合理的翻译单元)

- 对语音做语音增强与静音检测,对图片做图像增强与文字裁剪

这一环节看似不起眼,但它能显著影响后面翻译模型的表现——就像把菜洗干净才能保证口感。

识别与翻译引擎:锅里在怎么翻?

这里是技术的“火候控制”和“烹饪手法”。常见流程:

- 语音输入:先由ASR把声音转成文本,ASR会输出一个置信度和可能的多候选句。

- 图片文字:OCR识别后会输出文字与位置信息(用于对齐或原图返回)。

- 文本翻译:主流用的是基于Transformer的NMT模型,模型会输出译文及每个词/片段的注意力权重(用来做对齐)。

在工程实现中,还会根据场景切换模型或加载专用词表(比如医疗、法律、技术术语)来提升准确率。

后处理与质量评估:尝尝味道并记下来

模型输出后,系统会对译文进行一系列处理和评估:

- 去重与格式恢复:将被预处理移除的格式、行断恢复到译文中。

- 术语一致性校验:对照用户词表或行业术语库,替换或提示不一致处。

- 置信度评估:基于模型内部概率、对齐强度、语言模型得分合成一个置信分(confidence)。

- 自动质量指标:计算BLEU、ChrF、TER等自动分数,供内部参考或做批量统计。

- 错误分类:将可能的错误分为术语错误、漏译、拼写、语法或歧义等,便于后续聚合分析。

报告的内容结构:读一份报告你会看到什么

一份标准的易翻译报告通常包含以下栏目,按重要性和可读性组合展现:

| 字段 | 说明 |

| 原文 | 经过预处理后的输入文本,必要时保留原始音频/OCR截图的引用信息 |

| 译文 | 翻译引擎输出并经过后处理的最终文本 |

| 对齐/高亮 | 原文与译文的词或短语对齐,用于定位误译或漏译 |

| 置信度分 | 综合指标,表示这句译文的可靠程度(通常0–1或0–100) |

| 质量评分 | BLEU/ChrF/人工评分等,用于量化质量 |

| 错误类型 | 自动或人工标注的潜在问题分类 |

| 修正建议 | 自动给出的替换意见或给人工校对的提示 |

| 元数据 | 时间、使用模型版本、是否启用用户词表、是否人工校对等 |

举个更直观的例子

假设你拍了一张饭店菜单的照片上传来:

- OCR识别出“红烧肉 48元”,但由于光线,“红”被识成“纡”。报告会记录OCR原始文本、识别置信、并在对齐处高亮“纡→红”。

- NMT翻译输出“braised pork 48 yuan”,系统会检测货币格式并建议“¥48”或“48 CNY”,同时给出置信分0.92和建议把“红烧肉”翻译为“braised pork belly”(如果用户词表里有这个术语)。

- 最终报告里你会看到原图缩略、OCR结果、译文、对齐和建议修改项,方便人工确认或一键批量导出。

质量评估背后的逻辑:机器怎样判断好坏?

简单来说,质量评估分为自动评分和人工评分两条线:

- 自动评分:用BLEU、ChrF等对照参考译文打分,或用质量估计(QE)模型直接预测译文质量而不需要参考答案。

- 人工评分:人类译员或审核员根据流畅度、准确度、术语一致性给分,这部分会被记录进报告并作为训练或纠错的样本。

自动评分快但有局限,人工评分准但成本高。易翻译通常把两者结合,自动筛查出低置信或高风险条目,再触发人工复核。

隐私与数据保留:你的内容如何被保护

关于报告生成过程中的数据处理,常见的实践包括:

- 传输加密(HTTPS/TLS)与存储加密

- 敏感信息检测与脱敏(例如身份证号、银行卡号自动遮盖)

- 日志策略:标注哪些日志会保留、多长时间、以及用户是否可以删除历史

- 人工校对访问控制:只有授权审核员可查看原文或音频

如果你很在意隐私,可以在设置里关闭云存储或选择仅本地保存翻译结果(受限于功能)。

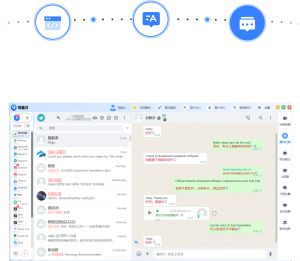

用户如何生成并使用报告(操作步骤)

下面是一条常见的操作路径,帮你实际把报告“生”出来并看懂它:

- 上传或输入内容:文本粘贴、录音或拍照。

- 选择场景/词表(可选):例如“旅游”、“技术文档”或加载你自己的术语表。

- 点击翻译并勾选“生成报告”或“包含详细质量信息”。

- 等待:系统先做识别(ASR/OCR),再翻译,随后做质量评估并生成可视化报表。

- 查看报告并决定:接受译文、按建议修改、或提交人工复核。

- 导出/保存:支持PDF/CSV/JSON等格式,便于归档或批量分析。

报告里的数值该怎么读?

- 置信度高(例如>0.9):译文通常可靠,可直接使用或仅做轻微润色。

- 置信度中等(0.6–0.9):建议人工浏览关键片段或核对专业术语。

- 置信度低(<0.6):通常伴随识别错误或歧义,最好要求人工复核。

常见问题与排查小贴士

这里列出一些实操中高频遇到的场景和快速处理方法:

- 翻译中出现专业名词错译:上传或编辑用户词表,或在请求中注明领域(如“医疗领域”)。

- 语音翻译误识别太多:检查录音质量,尝试降噪或提高采样率;开启方言模型(若支持)。

- OCR漏字或错字:拍照时保证光线充足、对焦清晰,或手动调整识别区域。

- 报告显示置信度与你预期不符:查看是否使用了不同模型版本或是否启用了特定过滤器(可在元数据部分找到)。

把报告当作“改善翻译”的工具来用

别只把报告当成翻译结果的最终凭证,把它当成诊断表和成长记录会更有价值:

- 定期分析低置信记录的共性(是某类术语、某种语速还是某个OCR场景),用这些样本训练专用模型或扩充术语表。

- 把人工校对的修改保留下来,作为系统微调的高质量数据。

- 把报告导出为表格,按问题类型聚合,形成可执行的改进计划。

技术人想看的深一点(可跳过)

如果你对内核细节好奇,核心点包括:

- 模型版本与热备:报告会带上翻译时使用的模型ID,便于复现或回退。

- 质量估计(QE)模型:基于特征工程或端到端神经网络直接预测句子质量,无需参考答案。

- 对齐信息来源:attention权重、交叉对齐或基于编辑距离的对齐方法多管齐下以提高准确性。

写到这里我突然想到一个小细节:很多人忽视的是“元数据”——时间、模型版本、是否使用了用户词表,这些信息对排查问题非常关键。报告里把这些都留着,后续回溯就方便多了。

好了,我就把这些关键点和实践经验写在这里,供你在使用易翻译生成报告时参考和操作。希望下次你打开那份报告时,能像看食谱一样一目了然,知道哪一步该调整、哪一步已经做得不错。